A britek megvalósítanák a Különvéleményt – Egyesek szerint azonban rasszista a terv

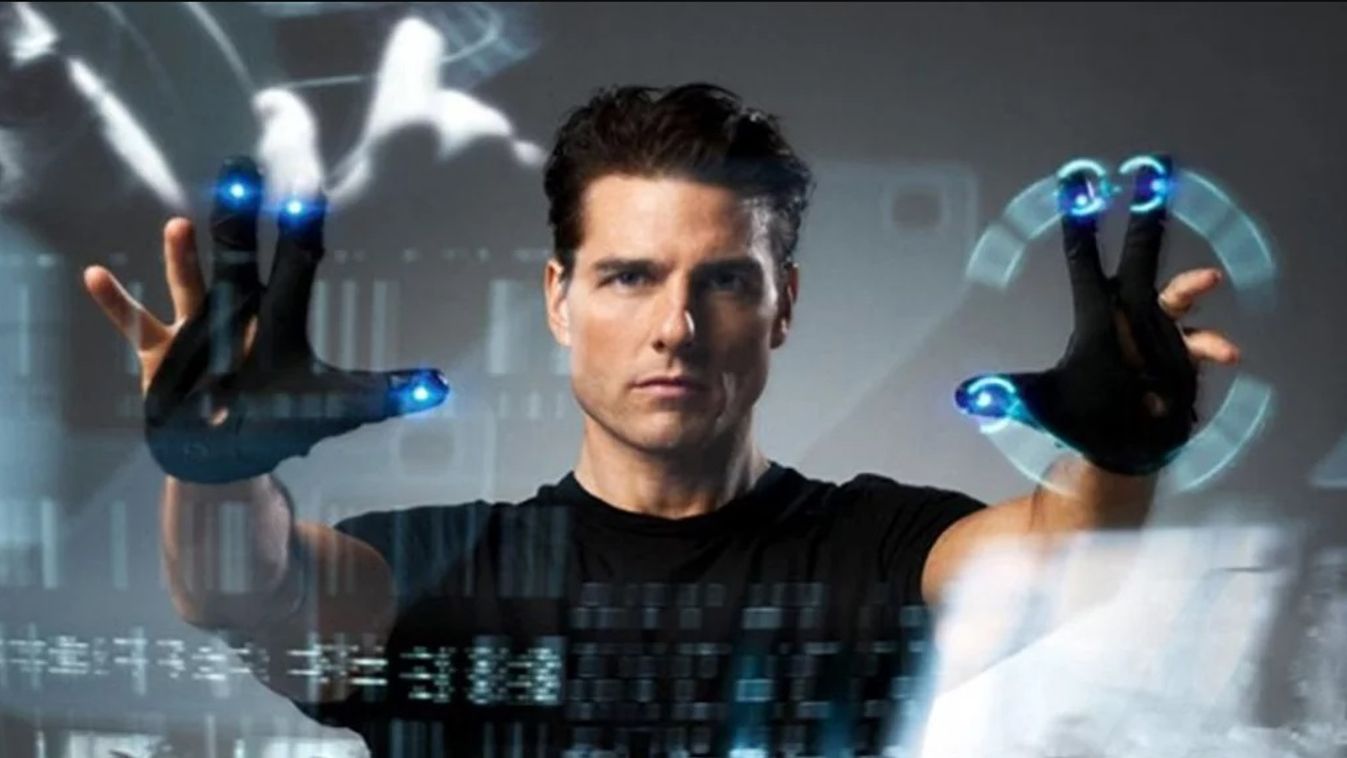

Manapság már nehéz disztópikus jövőképet alkotni, mert szinte minden megvalósul a jelenben. Alig több mint húsz évvel ezelőtt például még csak a Különvélemény című film témáját adta az ötlet, hogy a bűntények elkövetése előtt letartóztassák az elkövetőt, Nagy-Britanniában viszont most már tervben van egy, a filmben láthatóhoz hasonló módszer előkészítése. A baj csupán azzal van, hogy az algoritmus a vásznon szereplő jósokkal ellentétben meglévő sémákkal dolgozik...

2002-ben került a mozikba a Különvélemény című film. A történet szerint a jövő Amerikájában a rendőrség jóstehetségek segítségével előre megállapítja, hogy ki, hol, milyen bűntényt készül elkövetni, így annak megtörténte előtt el tudják fogni a "bűnöst". Ami alig több mint húsz évvel ezelőtt még tudományos-fantasztikum volt, mára már egy egészen közeli dolognak tűnik.

Nagy-Britanniában ugyanis már szinte használatra kész a szoftver, ami különféle sémák és algoritmusok alapján listát készítene azokról, akik a legnagyobb valószínűséggel hajthatnak végre erőszakos bűntényeket – írja a The Guardian. Valóság és fikció között azonban van néhány különbség. Elsősorban az, hogy a filmes verzióval ellentétben a brit belügyminisztérium nem tartóztatna le előre senkit, csak fokozott figyelmet irányítana azokra, akikről feltételezhető, hogy gyilkosságra, vagy egyéb erőszakos tettre készülnek, ők volnának az elsődleges gyanúsítottak.

Másrészt, ellentétben a Tom Cruise-ra rohamrendőröket küldő jósokkal, itt tudományos alapon készítenék el a szűrést. A program olyan algoritmusok és sémák alapján mérné fel a kockázati tényezőket, amelyek a tapasztalatok és tények alapján valószínűsítik, hogy képes lenne hasonló tettekre. És ez utóbbival van baja a jogvédőknek.

Rasszista programok

A különféle civil szervezetek szerint ugyanis a szoftver "előítéletes" lenne az etnikai kisebbségekkel szemben. Na most, ezzel az érveléssel az a baj, hogy mivel egy programról van szó, így nem beszélhetünk előítéletekről, csupán sémákról, amiket a rendszer követ. Ha például az algoritmus azt mutatja, hogy 1000 nemi erőszakból 879-et közel-keleti bevándorlók követtek el, akkor a gépi agy természetesen az előszűrés során ezt is figyelembe veszi. Ha a program szerint a londoni metrón tíz késelésből egyet sem fog megelőzni a "Deus Vult" felkiáltás, ellenben kilenc előtt az elkövető "Allahu Akbart" ordít, akkor a rendszer ezt is számon tartja majd.

Hibák a rendszerben

A jogvédőkkel ellentétben nekünk nem a gépi rasszizmus a problémánk, hanem az, hogy minden számítógépes rendszert emberek állítanak össze és emberek befolyásolnak. Nem a géppel van tehát a baj, hanem azzal, aki irányítja. Miután számtalanszor felmerült, hogy a ChatGpt, a Meta és egyéb mesterséges intelligenciák működését erős cenzúrához és ideológiai alapelvekhez kötötték a fejlesztők, nehéz elképzelni, hogy egy olyan szinten érzékenyített országban, mint Nagy-Britannia egy ilyen fontos programot ne befolyásoljanak hasonló elvek alapján.

A jogvédők tiltakozása pedig már számtalan esetben eredményezett a nyugati országokban pozitív diszkriminációt. Elég arra gondolnunk, hogyha egy őshonos brit leírja a migráns szót, akkor börtönbe kerül, az illegálisan bevándorló erőszaktevőket pedig legfeljebb rehabilitációra ítélik, akkor máris láthatjuk, hogy mi lehet a probléma. Ha a bíróságokat ilyen szinten befolyásolják a "jogvédők", akkor mi várható a program fejlesztőitől.

Félő, hogy az egyébként egész épkézláb kezdeményezést a végén arra fogják használni, hogy meghatározzák, ki veszélyezteti leginkább a közösségi média posztjaival a muzulmánok lelki békéjét, és nem arra, hogy felszámolják a grooming gangeket. Szegény John meg majd menekülhet a zsaruk elől mint Tom Cruise, pedig még le sem írta az N-betűs szót...

Fotó: Port.hu;